Berettiget harme eller overreaksjon?

Og hvor er vi egentlig på vei?

KOMMENTAR (PressFire.no): Nvidia viste fram sin nyeste spillteknologi DLSS 5, og internett ble satt i fyr og flamme.

Det som skulle være en magisk ny teknologi for å få spill til å se realistiske ut, falt på stengrunn i det «realistisk» også betydde «forandret hvordan ting så ut, gjerne med litt ekstra sminke».

I disse turbulente AI-tider har Nvidia, som allerede har forarget spillentusiaster med svindyre skjermkort og nå som en del av konklomeratet som kjøper opp alt av RAM, fått gjennomgå for å blande såkalt generativ AI med spillgrafikken.

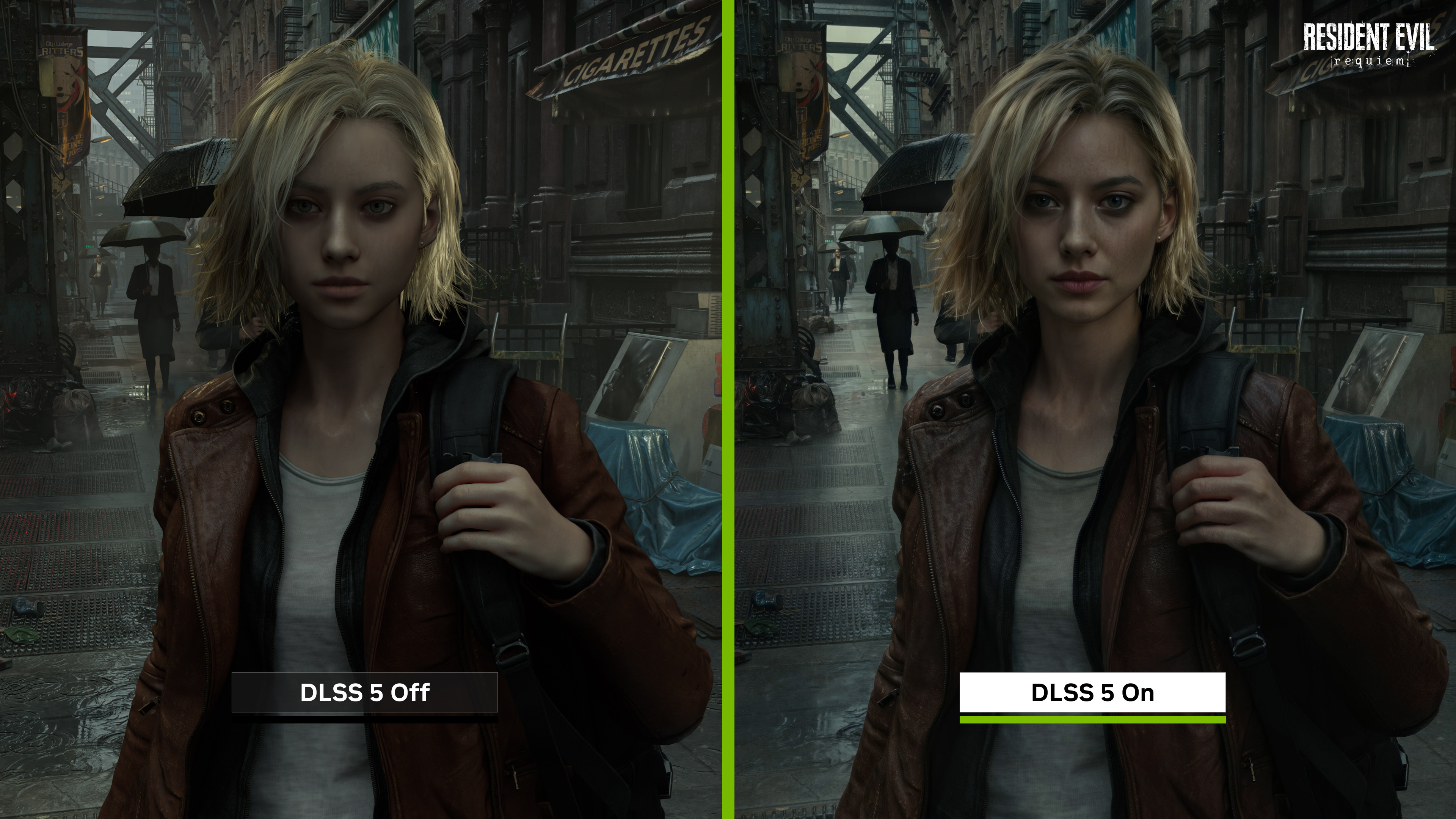

Et enkelt blikk på det aller første bildet de ga ut var for mange nok:

Misforstå meg rett – jeg er ingen fan av hvordan dette ser ut – men det er en liten berg-og-dal-bane som foregår i hodet mitt her.

Jeg elsker ny teknologi, og mye av det som er mulig i dag er nesten ikke til å tro. Spol få år tilbake og verden var en veldig annerledes plass.

At en automatisk tjeneste kan ta et videosignal og bare endre alt som vises på noen få millisekunder er svimlende. Samtidig er resultatet temmelig nedslående.

Som er sånn jeg føler det med alt av AI.

Det er mange varianter av AI-systemer, og det finnes gode og dårlige måter å bruke AI på. AI-systemer som både begeistrer og skuffer hele tiden.

Jeg HATER hele konseptet med generert kunst på denne måten. Bilder, video, fortellinger, musikk – jeg vil ikke ha det. Det er ikke nødvendig.

Jeg driter i om det høres og ser bra nok ut. Ingen problemer løses ved at vi ikke selv skal skape kunsten vi konsumerer. AI-generert kunst er en løsning til et ikke-eksisterende problem.

Som er en hyklersk stilling å ha, for jeg har da vitterlig generert mye av dette selv. Jeg har lyttet på AI-musikk og hatt rockefot. Jeg har sett AI-bilder som jeg synes har vært kule.

Jeg har garantert konsumert tradisjonelle medier spedd på med AI-innhold uten å vite det.

Vi har alle det.

AI-bruk er ikke noe nytt for de spillinteresserte.

Spillmotorer er stappfulle av hjelpemidler og automasjon av ting som før måtte gjøres for hånd. Det er vel neppe noen som tar til stridsøksen over at buskas autogenereres i en skog i bakgrunnen i Unreal Engine 5, eller at animasjoner ikke lenger håndlages bilde for bilde.

Og AI brukes til å kode overalt i dag, også i spill.

Om du skal kutte ut alt som er laget med AI som hjelpemiddel og verktøy må du revertere til amish-lignende tilstander. Du kan ikke lese nyheter mer.

Men det å skulle skape kunst som andre skal konsumere utelukkende ved hjelp av generativ AI gir en dårlig smak i munnen.

Det er nesten så jeg har dårlig samvittighet over artiklene jeg skreiv for noen år tilbake der jeg brukte tidlige AI-modeller til å «gjenskape» gamle spill.

Den gangen var teknologien spennende og nyskapende, og jeg fikk stjerner i øynene av mulighetene.

For jeg tenkte jo at AI skulle gjøre drittarbeidet og la oss fokusere på å skape ting sjæl.

I stedet har AI blitt buzz-ordet fra toppledelser som vil barbere vekk arbeidskraft, uten å vite hva styrkene til AI egentlig er. Det trenes hundrevis av AI-modeller på stjålet innhold, mens obskøne energihungrige datasentre bygges overalt for å drifte chat-klienter som i stor grad brukes til svada – og i verste fall til krig og elendighet.

Usannsynlige pengesummer pumpes inn i AI-blindspor som bare ikke kan bli bra, eller som forsøker seg på problemer som allerede har mer enn bra nok løsninger.

Samtidig har AI helt legitime bruksområder som jeg jo oppriktig har store håp og forventninger til.

Å dumpe enorme datamengder på AI og finne nåler i høystakker er gull verd, og tidsbesparelsene enorme. Det å bruke AI til å gjenkjenne mønstre i sykdommer og utvikle nye medisiner, design av hjelpemidler og slikt er selvfølgelig ingen mot.

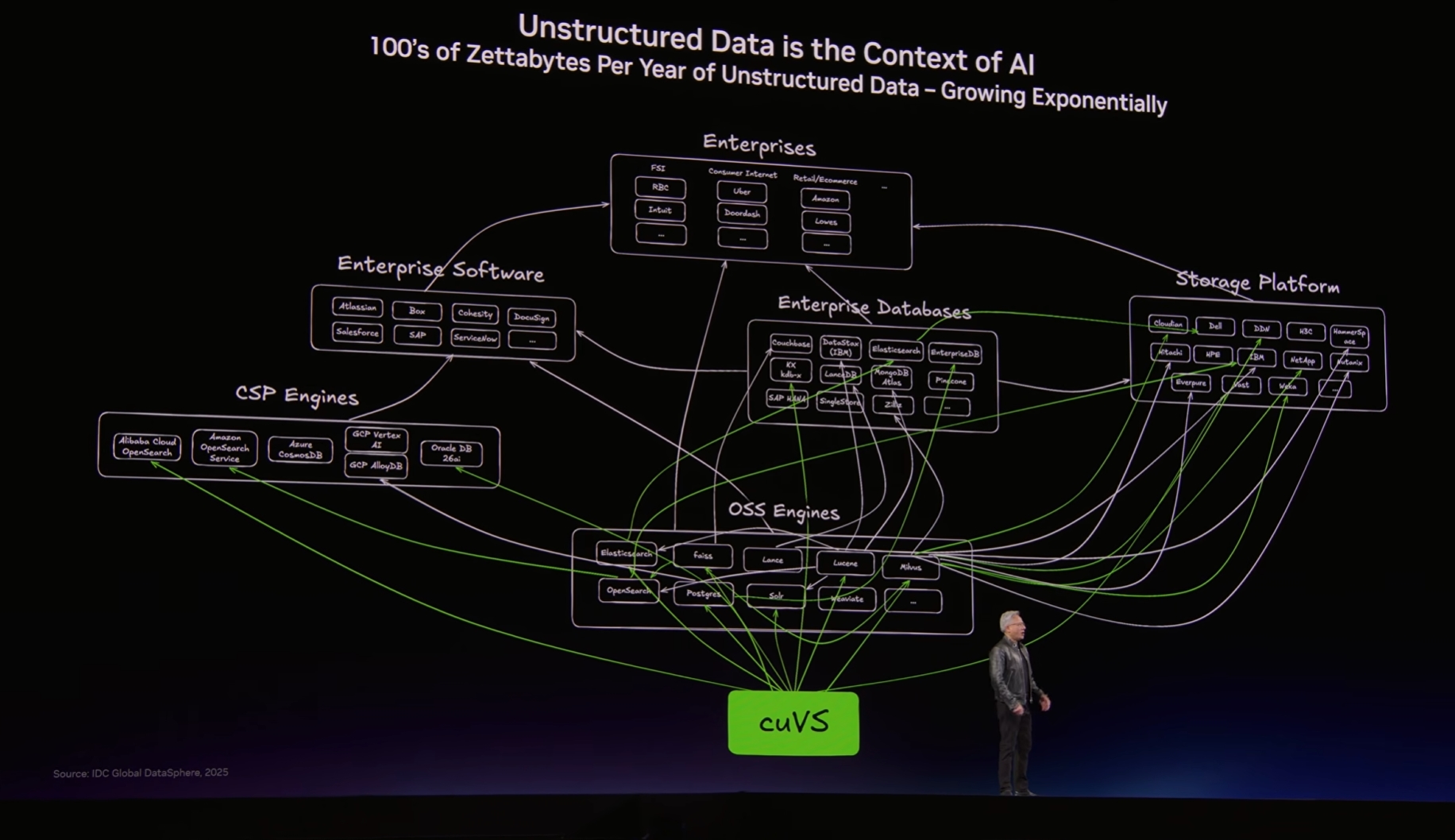

En liten digresjon, kanskje, men det tar meg jo til denne ukas store snakkis: Nvidia og tuklingen med skaperverket.

Den øyeblikkelige reaksjonen min var som mange andres her: «Æsj, hva i all verden er det de har gjort».

For øynene mine dras mot ansiktene til figurene. Mennesker er jo laget for å ta til oss ansikter og å dras mot blikket til andre.

Og her har det skjedd mye rart.

Da bildene og videoene først kom uti ville jeg ikke rope «AI Slop» sånn uten videre, det syntes jeg ble for enkelt – det var fortsatt litt usikkert hvordan denne teknologien fungerte.

Jeg husket tilbake til tidlige versjoner av DLSS og hvor mange feil den kom med – hvordan modellen måtte trenes på hvert eneste spill.

Og hvor utrolig bra det fungerer nå.

Kanskje var ikke modellene helt skrudd til her? Kanskje var det noen hos Capcom som oppriktig (og feilaktig) mente at Grace skulle se sånn ut? Kanskje dette kunne fikses?

DLSS har vært en maskinlærings-revolusjon for gaming, som har utfordret hele konseptet med høy oppløsning i spill, og hva bildeoppdateringer faktisk er.

I dag er det ofte bedre bildekvalitet og flere detaljer med lavere oppløsning i bånn enn om du bare «brute forcer» inn høyere oppløsning – noe som for meg rett og slett er magi.

Et bilde på 720p som oppskaleres vil i mange tilfeller se like bra ut som 4K.

Sjekk ut denne spinnville videoen der spill kan kjøres med 0,01 prosent av pikselene og det likevel er mulig å se hva som skjer:

Kvaliteten på pikslene er like viktige som antallet i dag.

Switch 2 for eksempel, puncher langt – LANGT – over hva de ynkelige åtte wattene konsollen bruker takket være innebygd støtte for DLSS.

Faktisk spruter teknologien på Switch 2 opp bildekvaliteten så mye at den ofte kommer fordelaktig ut i møte med langt kraftigere hjemmekonsoller.

I etterkant har «DLSS» blitt en paraplybetegnelse på mye av maskinlærings-greiene i Nvidia-kort.

«Frame generation», der kortene setter inn unike frames mellom de som rendres til vanlig, har bare blitt bedre og bedre, mens «Ray Reconstruction» og «Deep Learning Anti-Aliasing» forbedrer ray-tracing og kantutgjevning.

DLSSSR, DLSSGF, DLSSRR, DLAA har alle blitt introdusert gjennom DLSS 2, 3 og 4.

Det er mye å bite over, for PC-teknologi har blitt ganske helsprø de siste årene. Og nå skulle altså DLSS 5 ta det hele enda et steg videre.

Det ble ikke akkurat som Nvidia hadde forventet.

Reaksjonene kom raskt og hardt fordi dette ligner på disse elendige genererte bildene som er overalt i disse dager – og som enn så lenge er ganske enkle å spotte.

Og fordi det var åpenbart at DLSS 5 la til detaljer der de ikke fantes allerede.

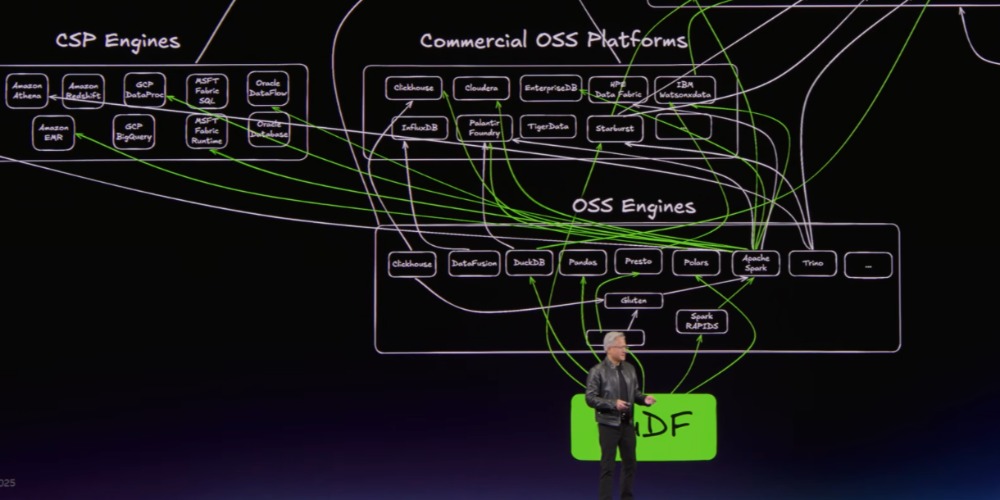

Nvidia forsøkte desperat å si at det ikke var et filter, og toppsjef Jensen Huang forklarte at dette var en teknologi som gikk helt ned til geometri-nivå.

Altså at DLSS 5 brukte mye mer fra spillet enn bare videosignalet.

Svar gitt til youtuber Daniel Owens under her peker derimot dit at modellen kun har tilgang til det ferdige bildet og bevegelsvektorene (retningen ting beveger seg).

Han betegner det hele som et filter som bruker disse 2D-bildene for å produsere hva enn den mener er et mer realistisk bilde.

Men det er for enkelt å si at dette bare er et filter.

DLSS 4 bruker også «bare et bilde» til å skape det endelige resultatet, og ingen mener at det er et filter.

De tidligere modellene av teknologien trenes opp på vanvittige datasett for å kunne gjenkjenne former og kanter og kunne tilføre mikroskopiske detaljer. Resultatet er som jeg nevnte over at vi i dag nesten ikke kan se forskjell på et bilde som er 4K eller et bilde som er oppskalert til 4K.

Den samme teknologien er i sving her, der pikslene i bildet bygges opp med mye mer informasjon i bunn.

Men nå har åpenbart Nvidia tatt steget vekk fra å bare skulle gjenkjenne kanter og endre på sub-piksler med innhold i gangen. Nå er modellen trent på mennesker og gjenstander.

I stedet for å rekonstruere bildet så likt originalen som mulig, skal Nvidia sette fasit på hvordan et «perfekt» bilde skal være – og det er tydelig at denne modellen ikke fungerer slik de håper eller tror.

Men det er ikke et filter.

Eller en «vanlig» generativ AI-modell som tar hvert bilde og genererer et nytt.

Du kan ikke kjøre dette inn i ChatGPT og få tilsvarende resultater, fordi ChatGPT og andre modeller jobber på en helt annen måte. Kjør bildet inn tjue ganger og du får tjue varianter tilbake.

Det er liksom det som er greia til DLSS og andre maskinlærings-teknologier i paraplyen.

De produserer konsekvente resultater, fordi treningsdataen, input-en og instruksjonene er de samme. Det gjør at bildet framstår mer stabilt og at spillet vil se likt ut hos alle spillere.

I teorien kunne jo dette gå an.

I praksis falt korthuset sammen.

Mennesker er for gode til å se når ansikter ikke er som de skal. Og modellen virker ikke å ha nok data å jobbe med, samme hvor mye data som går inn i pikslene til å begynne med.

Det som holdt for DLSS 4, er åpenbart ikke nok for DLSS 5.

Lærdommen for Nvidia bør nok være at de ikke legger ut noe så ambisiøst og så oppblåst før det er helt ferdig, testet – og testet igjen.

Om det er feilaktig trent på dårlig data som gjør at modellen her velger studiobelysning på alt, bleket hår og maskara vet jeg ikke.

Men resultatet er at alt ligner på et AI-filter som dytter folk og fe inn i uncanny valley.

Og det er litt akilleshælen: Det spiller ingen rolle hvor fantastisk teknologien er eller hvor imponerende realistisk lyset sprer seg under huden på figurene – om det ser ut som «AI slop», så er det «AI slop».

At ansiktene er blitt snåle er enkelt nok å påpeke, men min største innvending er mer at alle spillene som Nvidia viste fram, som er distinkte spill med sine egne kunstretninger, nå smørjes sammen og ser veldig likt ut.

Liverpool-stopper Virgil Van Dijk, zombie-skyter Grace Ashcroft og random NPC-er fra «Starfield» ser alle ut som de kommer fra samme spill.

Jeg er usikker på om fotorealisme skal være den hellige gralen vi ønsker oss i alle spill. Fotorealisme er ikke noe som gjør at spill nødvendigvis ser bra ut.

En god art direction i spill er gull verd, og DLSS 5 tøyser det til her.

Se på «EA FC»-eksempelet. Spillet går allerede for realisme i hvordan det ser ut.

Og med DLSS 5 ser det unektelig bedre ut, selv om Virgil Van Dijk ser litt ut som han står i et studio, han også.

Van Dijk er en av de mest kjente fotballspillerne i verden, og det er jo derfor sannsynlig at han er med i svært mange bilder som Nvidia har trent DLSS 5 på.

Jeg vil tippe at det er grunnen til at han ser temmelig bra ut her.

Om EA hadde vist fram spillet og det hadde sett ut som bildet til høyre her, og de ikke hadde nevnt DLSS 5, tror jeg folk hadde vært fra seg av begeistring.

Men alle de andre spillene har distinkte visuelle retninger som ikke har gått for fotorealisme.

De har alle jobbet rundt teknologiene som var tilgjengelige for dem og skapt spill som har visuelle særpreg, gjerne med helt urealistiske elementer som er med på å gjøre dem unike.

DLSS 5 kommer inn med kluten og prøver å vaske det inn i det samme realistiske sporet som «EA FC», og modellen greier ikke å holde tritt.

Spesielt merkbart er det i ansiktene. Det virker rett og slett som at noe er off. Fjesene ser feil ut, feil fargemetning og overskarpt bilde.

Tydeliggjort med Grace sin figur, som i ekstreme nærbilder i hvert fall ligner noenlunde på seg selv – selv om hun også her har fått litt ekstra øyenskygge.

Men når ansiktene tar mindre plass på bildet må modellen jobbe hardere med færre piksler, og resultatet blir at den lager noe nytt.

Noe nytt som, igjen, kan vitne om at Nvidias trening av modellen ikke er som den skal.

Og kanskje aldri kan bli.

Og da ender vi opp med en «jazzified» Grace som har bleket håret og sminket seg opp for å …motvillig dra til stedet hun så moren bli drept med machete.

Jada. Kontekst er heller ikke noe modellene har.

I eksempelet med Hogwarts Legacy blir hovedfiguren kjørt gjennom prosessen som femtenåring og spyttet ut på den andre siden dobbelt så gammel.

Modellen aner jo ikke hvor gammel han skal fremstå i spillet.

Jeg er også usikker på om utviklernes intensjoner kan ivaretas her.

Jeg kan ikke tenke meg at det er mange spillutviklere som ønsker at spillene deres skal få denne etter hvert så distinkte «looken» som AI-modellene i dag tramper ut i – og lovnadene om at utviklere vil kunne skru på det som kommer ut virker litt platt.

Nvidia sier utviklere kan justere intensiteten og fargebalansen, men det virker å være alt.

Det virker ikke som om utviklerne kan si «ikke sleng på maskara på Grace, er du snill», eller «bare fiks på denne her spesifikke tingen».

Men DLSS 5 gjør jo åpenbart mer enn bare å fikse litt på lyssettingen.

Implementeringen vi nå har sett tar sluttresultatet til arbeidet fra alle de som jobbet på spillet og gjør mye av det på nytt.

Det er kontroversielt.

Noe som vil skje her er at folk kommer til å modde inn DLSS 5 i spill som ikke har hatt det i tankene.

Resultatet av det vil nok i stor grad være grufulle greier.

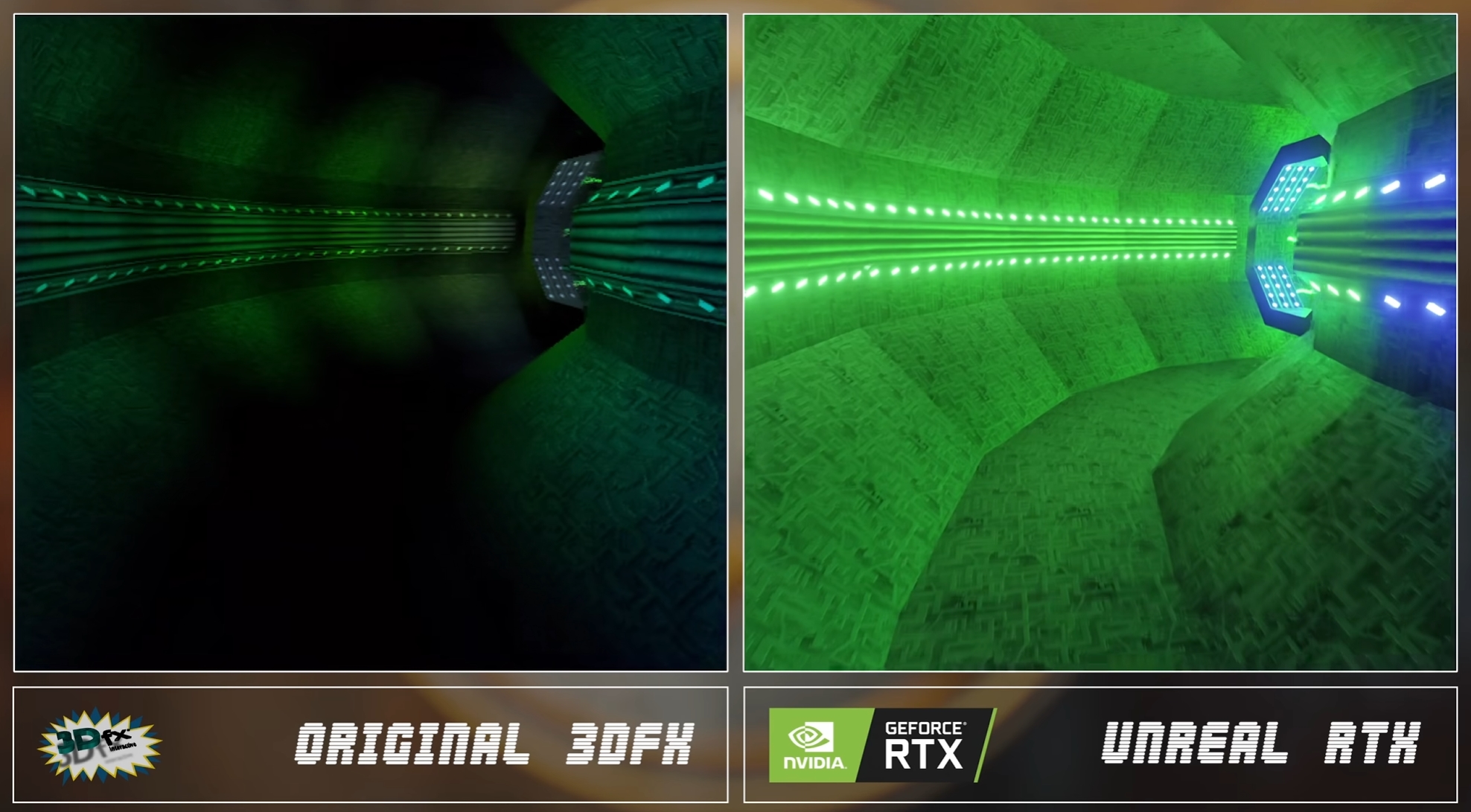

Jeg får litt flashbacks til en video jeg så av «Unreal» som har en «RTX»-versjon der folk har dyttet inn «realistiske» refleksjoner og lyssetting, noe de som utviklet spillet ikke hadde i tankene da de lagde spillet.

Det ser helt jævlig ut.

Jeg grøsser også ved tanken på at utviklere kanskje vil kaste seg over dette og legge lista for arbeidet sitt enda lavere.

La oss si at DLSS 5.1 eller 6 – eller 10 for den saks skyld – greier å fikse alle innvendinger vi har med det vi har sett til nå. Kan du tenke deg mengden blankpolert dritt vi vil få servert?

Vi ser allerede en obskøn mengde spill som klemmes ut av folk som ikke kan å lage spill – mye takket være AI-hjelpemidler.

Hvorfor optimalisere og gjøre ting så bra som mulig om du kan skru på DLSS i fremtiden for å få lappet over det som ikke helt fungerte bra?

Å være medlem på indiespill-grupper i sosiale medier nå er omtrent så trist som det kan få blitt.

Forleden så jeg et «spill» reklamert for av en utvikler som hadde generert fem-seks bilder av et kjøleskap, fått ChatGPT til å dra et bilde av en flue over skjermen innimellom som du måtte klikke på og så gitt det ut på App Store.

«Stop the fly from getting the food!» kunne han stolt ubasunere i gruppen, som om dette var råflotte greier.

Null forståelse for hvor absolutt shit det hele var. Null peiling på hva koden ChatGPT hadde spyttet ut betydde, og null idé om spilldesign generelt.

Den idéen om at AI-teknologien gir flere mulighet til å lage det de magiske opplevelsene de alltid har drømt om har, for menigmann, foreløpig bare endt i fjell med søppel.

I stedet har vi en uendelig generert jungel av skvip som det blir vanskeligere og vanskeligere å navigere, og som bare skaper en ekkel smak i munnen når du finner noe som virker bra – men som bruker søppelet til å ernære seg.

Det føles litt som om DLSS-vogna har blitt kjørt for tidlig inn på et spor den ikke burde være i, og at Nvidia har dummet seg ut.

Nvidia har dratt noe uferdig ut av posen som viser en potensiell retning for spillbransjen som kombinerer generativ AI med allerede produserte dataspill.

Men folk flest har ikke snøring på hva forskjellene på generative AI-systemer er. Eller hvordan de fungerer.

Og Nvidia og de andre evner ikke å forklare det heller. I stedet koker de det ned til buzz-ord for å tekkes investorer – og skyter seg selv i foten samtidig.

Det gjør at diskusjonen rundt generativ AI forblir grumsete, for mange forbinder hele uttrykket med ChatGPT og «AI slop». Det gjør at det blir vanskelig å diskutere spesielt denne implementeringen.

For det er ingen datasentere som står og putrer for å få disse endringene, slik det er når ChatGPT genererer innhold – det er skjermkortet ditt som gjør det lokalt.

Er modellene her trent på stjålet innhold?

Sikkert.

Det samme er sannsynligvis modellene som driver Switch 2 og PlayStation 5 og tilsvarende teknologier som FSR og alt annet også.

Jeg ser ingen som roper om «AI slop» til bruken av DLSS i «Final Fantasy VII Remake» på Switch 2 for at bildet skal se bedre ut. Faktisk ser jeg bare trampeklapp til teknologien.

Om Nvidia hadde presentert noe som ikke tøyset til ansiktene på folk så mye, hadde vi snakket om «AI slop» da?

Hva om de hadde vært litt mer restriktive og gjort slik at denne modellen kun rettet på refleksjoner eller gjorde vann litt mer realistisk?

Hadde folk reagert da? Selv om teknologien bak var helt lik?

Kommer folk til å reagere slik når AI-modeller for komprimering av teksturer på et eller annet tidspunkt vil løse RAM-krisen som er nå?

Jeg har jo mine tvil.

DLSS 5 lyssetter og skyggelegger tilsynelatende vanvittig bra i scenene der bevegelse er minimal og detaljrikdom allerede stor. Det er faktisk helt spinnvilt at dette gjøres i sanntid, kun basert på videosignalet fra spillet.

Det er blitt et lyspunkt i en ellers så kynisk spillbransje å se at spillerne virkelig ikke ønsker å ha «AI slop» i spillene sine.

Men samtidig er det et tve-egget sverd, for spillerne vet liksom ikke helt hva «AI Slop» er – og det blir vanskeligere å definere det jo lenger tid som går.

Folk gikk forrige uke gjennom Nvidias DLSS 5-bilder med lupe for å finne små detaljer som er feil for å forsvare ståstedet sitt – gjerne så små feil at ingen merket dem før dager etter annonseringen.

Men tror vi, helt ærlig, at dette er endestasjonen for teknologien? Det er i så fall utrolig trangsynt – på grensa til usaklig – når vi vet hvor vi var for bare ti år siden.

Hva gjør vi når vi helt oppriktig ikke greier å se forskjell mer? Jeg aner ikke. Jeg vet bare at vi snart er der.

Det er blitt slik at vi lever i interessante tider.

Vi går mot en tid hvor vi faktisk ikke greier å se forskjell på generert og ikke-generert. En tid der AI vil være i midten av all teknologi.

Spillbransjen er på vei i full fart inn i nettopp dette sporet, men er på langt nær det eneste feltet. Absolutt alle piler peker i retningen av mer bruk av AI og maskinlæring. Overalt.

Som gjør ting som er så avanserte at vi ikke greier å skjønne det.

På godt og vondt.